Machine-Learning-basierte Identifikation von Fake News, Hate Speech und extremistischen Dynamiken – innovative Methoden in der Analyse von Social-Media-Daten

Die Anzahl an Social-Media-Nutzerinnen und Nutzern steigt kontinuierlich, sowohl für den privaten Gebrauch als auch zur professionellen Informationsbeschaffung. Leider gehören dazu auch Fake News, Hate Speech und extremistische Dynamiken, die die freiheitlich-demokratische Grundordnung bedrohen. Provokante, beleidigende und falsche Kommentare können sich über Social Media scheinbar ungehemmt verbreiten. Lösungen werden gesucht, um solche Beiträge gezielt aus einer schier unüberschaubar großen Menge an Aktivitäten identifizieren und ihnen beispielsweise im Rahmen der Kriminalprävention begegnen zu können.

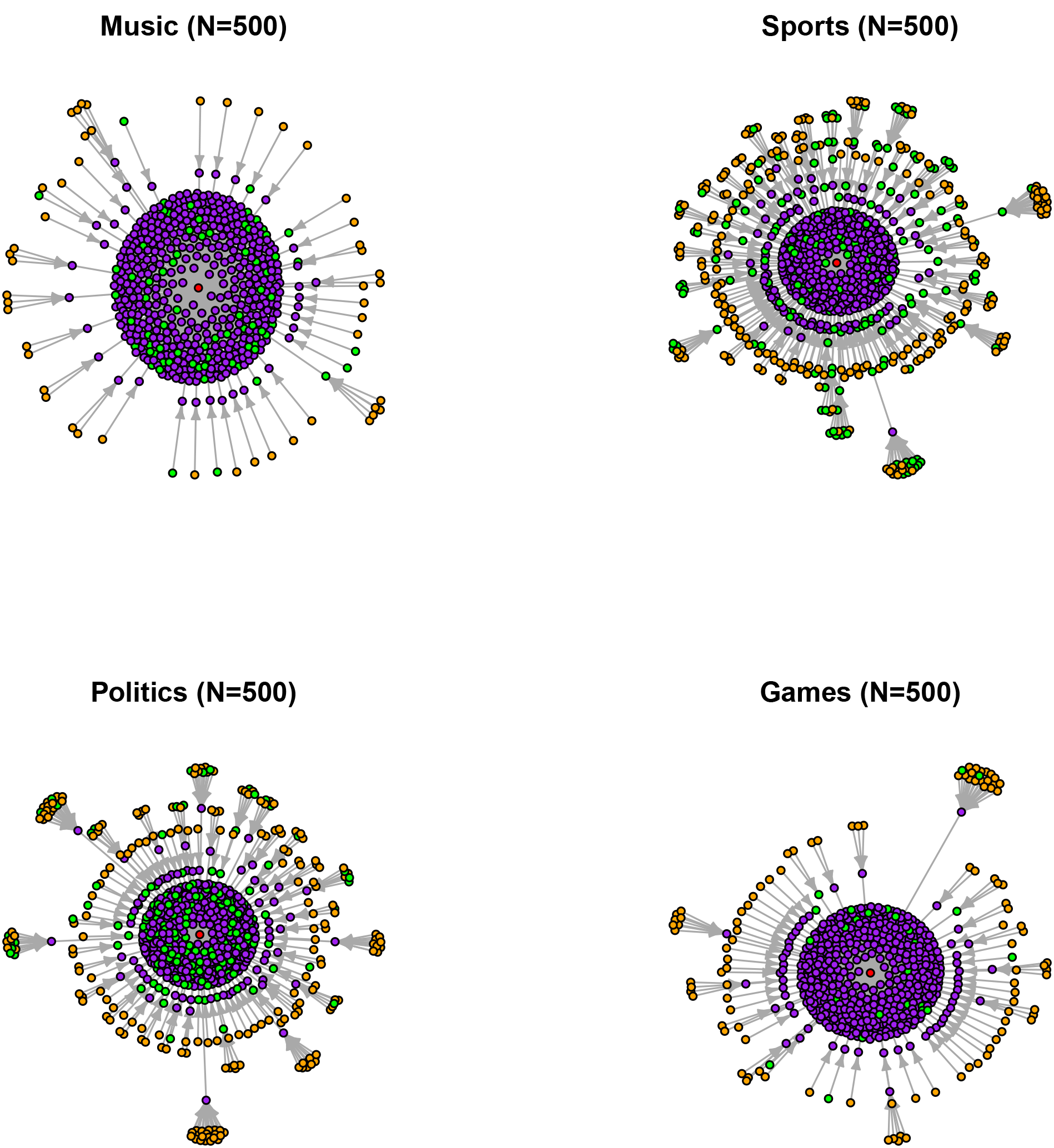

Prof. Dr. Dennis Klinkhammer vom ifes Institut für Empirie & Statistik der FOM hat herausgefunden, dass die Kommunikationsmuster in sozialen Medien maßgeblich durch die übergeordneten Themen der Social-Media-Kanäle beeinflusst werden. Die Kommunikationsmuster beim Thema Sport ähneln beispielsweise bedeutend denen beim Thema Politik, wie er in seinem methodischen Grundlagenbeitrag mit dem Titel „Analysing Social Media Network Data with R: Semi-Automated Screening of Users, Comments and Communication Patterns“ herausstellt. „Sowohl beim Sport als auch in Bezug auf politische Themen wird auf Social-Media-Kanälen engagiert kommuniziert. In der Reichweite, gemessen an der Anzahl der aktiven Nutzerinnen und Nutzer und deren Kommentaren, aber auch in der Art wie eine Kernaussage durch ein soziales Netzwerk transportiert wird, ähneln sich Sport und Politik mehr als bspw. die ebenso beliebten Social-Media-Themen Musik und Computerspiele“, so der Forscher. In der Grafik sieht man, wie sich Themen verbreiten (grün), wie kommuniziert oder geantwortet (violett bzw. orange) und wie weitreichend kommuniziert wird (Anzahl der Ringe). Diese Erkenntnis ist eine wichtige methodische Grundlage für eine automatisierte Identifikation von Fake News, Hate Speech und extremistischen Dynamiken. Diese verbreiten sich entlang fast aller gängiger Social-Media-Themen und -Kanäle. Allerdings verbreiten sie sich innerhalb der Themen auf unterschiedliche Art und Weise. Wenn man das grundlegende Kommunikationsmuster kennt, kann man deren Besonderheit umso gezielter erkennen.

Gestern wurden weiterführende Befunde in dem Sammelband „Extremistische Dynamiken im Social Web – Befunde zu den digitalen Katalysatoren politisch und religiös motivierter Gewalt“ mit einem Beitrag des FOM Wissenschaftlers veröffentlicht. Das Werk erscheint mit einem Vorwort des Innenministeriums NRW zur Bedeutung der Themen Fake News, Hate Speech und extremistische Dynamiken im Verlag für Polizeiwissenschaft. In seinem Beitrag geht Klinkhammer insbesondere auf die quantitativen Indikatoren für Radikalisierung und Extremismus auf YouTube ein. Es geht darum, wie man diese beispielsweise über die Programmiersprachen R und Python adressieren und in ein geeignetes Machine-Learning-Modell zur automatischen Identifikation von Extremisten und Terroristen nutzen kann. Dies könnte die Kriminalprävention dahingehend vereinfachen, dass nicht mehr alle Kommentare in Social-Media-Kanälen auf mögliche Rechtsverstöße überprüft werden müssten, sondern dass eine sorgfältig getroffene Vorauswahl den Fokus schärft, ohne dabei falsche Verdächtigungen aufkommen zu lassen.

Professor Klinkhammer setzt das Verfahren ebenfalls in seiner Lehre, u. a. im Bereich „Praxis der Datenanalyse“ am FOM Hochschulzentrum Köln, ein: „Die Studierenden greifen die Methode gezielt auf und adaptieren sie eigenständig und zu ihren jeweiligen Studiengängen passend. Daraus sind beispielsweise Arbeiten im Gesundheits- und Sozialmanagement zum Thema Prävention von Mobbing, aber auch zur rechtzeitigen Erkennung von gegen Unternehmen gerichteten Shitstorms in den Business-Studiengängen entstanden. „Schließlich geht es darum, dass das Internet auch wirklich nett bleibt“, scherzt Klinkhammer.

Prorektorat Forschung | 17.12.2020

Suche nach Beiträgen

Beitrag teilen

Zehn Jahre Digital Health im Fokus – Ein Interview zur Erfolgsgeschichte der Tagung „eHealth & Society“

Zehn Jahre „eHealth & Society“ (eHS) – ein Jubiläum, das nicht nur für fachliche Exzellenz steht, sondern auch für beständiges Engagement, Teamgeist und Innovationskraft. Hinter der erfolgreichen Transfertagung steht ein engagiertes Tagungskomitee, das mit Weitblick und Leidenschaft Jahr für Jahr den Austausch zwischen Gesundheitswissenschaften und -praxis ermöglicht.

WeiterlesenInternationalisierung der Forschung an der FOM: Kooperation mit der TU Sofia und der FDIBA

Die FOM Hochschule verfolgt eine konsequente Internationalisierungsstrategie in der Forschung, um wissenschaftlichen Austausch, transnationale Netzwerke und anwendungsorientierte Erkenntnisse zu stärken. Ein zentrales Element dieser Strategie ist die Zusammenarbeit mit internationalen...

WeiterlesenCall for Papers: Storytelling in Business Communication

Unter der Überschrift „Storytelling: The Power of Stories and Narratives in Business Communication and Media Discourses“ zielt die diesjährige Konferenz des Forschungsnetzwerks „Europäische Kulturen in der Wirtschaftskommunikation“, kurz EUKO, darauf ab, ...

Weiterlesen